Jeszcze 30 lat temu nikomu nie śniły się czasy, kiedy to wchodząc do sklepu z odzieżą, informacje o nas – kliencie – trafiają do bazy danych, która przechowuje o nas takie dane jak płeć, wiek czy poziom zadowolenia. A wszystko to tylko po to, aby w przyszłości lepiej dopasować asortyment i wystrój sklepu. Inna sytuacja: podjeżdżamy do bramek wyjazdowych z lotniska, a system na podstawie naszej tablicy rejestracyjnej decyduje, czy otworzyć szlaban. Jeśli uiściliśmy wcześniej opłatę za postój, szlaban oczywiście zostaje błyskawicznie podniesiony. Mechanizm ten świetnie działa chociażby na lotnisku Pyrzowice-Katowice.

Te sytuacje to nie sceny z filmów Sci-Fi, a życie codzienne, w którym zaawansowane, drogie i tajemnicze mechanizmy analizują otoczenie, obiekty i ludzi wyłącznie w celu wykonania odpowiednich czynności bądź zbudowania bogatej bazy danych o nas samych. Te same mechanizmy używane są także przez wojsko, policję czy nawet straż miejską, które to na podstawie obrazu z monitoringu są w stanie wytropić złodzieja.

Z tych mechanizmów nawet w 2011 roku skorzystało amerykańskie wojsko do zidentyfikowania ciała Osamy Bin Ladena. Co jednak najlepsze, także i my dziś możemy całkowicie za darmo korzystać z dobrodziejstw tak zaawansowanych algorytmów, które można śmiało zakwalifikować jako Sztuczna Inteligencja. Pozwala nam na to system Windows 10 w najnowszej odsłonie Fall Creators Update. Mowa oczywiście o analizie zawartości naszej kolekcji zdjęć.

Czasy klisz fotograficznych minęły bezpowrotnie. Klisza na 36 zdjęć pozwalała nam jednorazowo po wywołaniu dołożyć do naszego albumu kilkanaście dobrych ujęć (bowiem niejednokrotnie wiele zdjęć było prześwietlonych). Nietrudno było je odpowiednio skatalogować, a później odszukać. Jednakże gdy nadeszła era aparatów cyfrowych, liczba fotografii, które wykonujemy na wyjazdach wakacyjnych czy nawet w codziennym życiu, przekracza najśmielsze prognozy producentów z lat ‘90. Sam prywatnie posiadam kolekcję 100GB zdjęć, co przekłada się na około 40 000 ujęć. Zdaję sobie sprawę, że gdybym poświęcił kilka dni na ich przejrzenie, zapewne 30% wylądowałoby w koszu, jednak mam duży sentyment do fotografii.

Odnalezienie się w takiej kolekcji jest dla mnie sporym wyzwaniem. Dotychczas mój ład opierał się na skrupulatnie ponazywanych katalogach, a dodatkowo filtrowaniu fotografii po latach i miesiąc, pod warunkiem, że pamiętałem, kiedy były one wykonane.

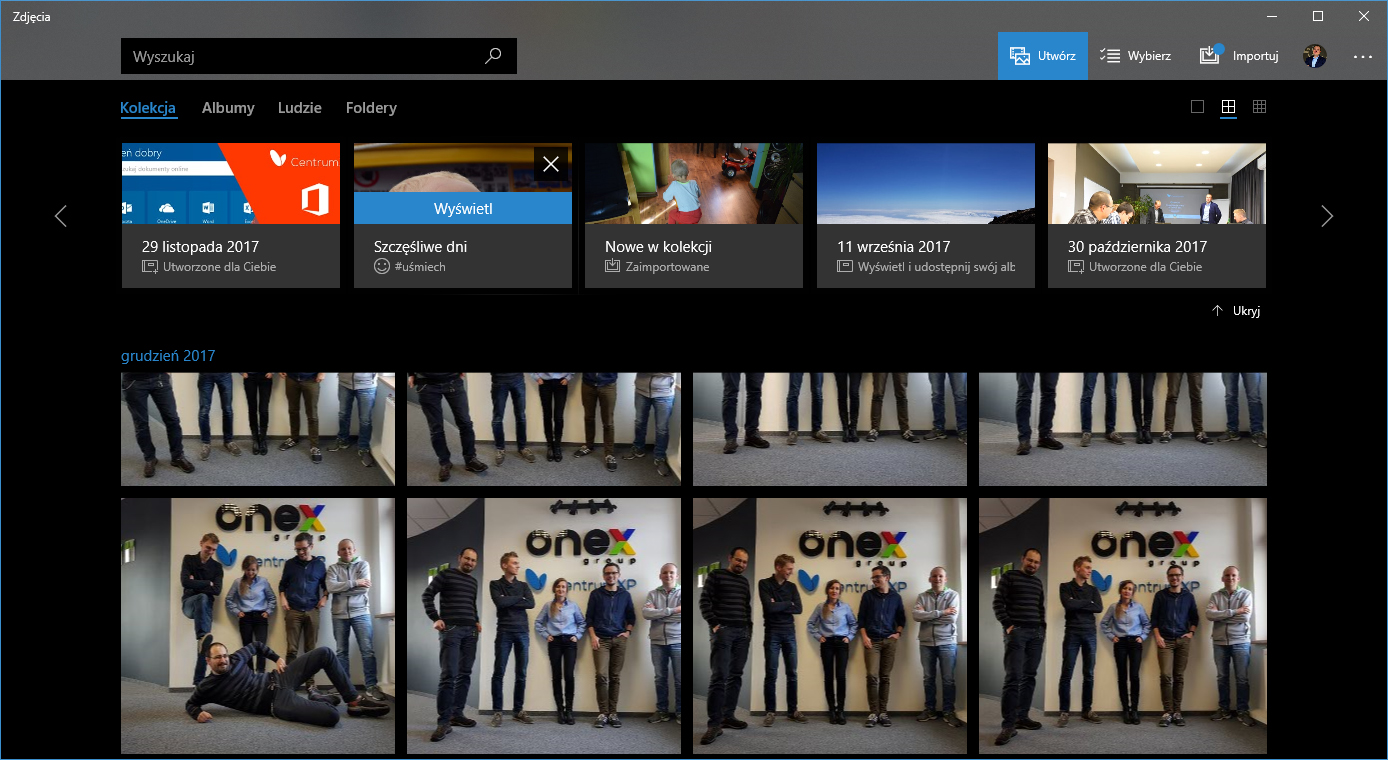

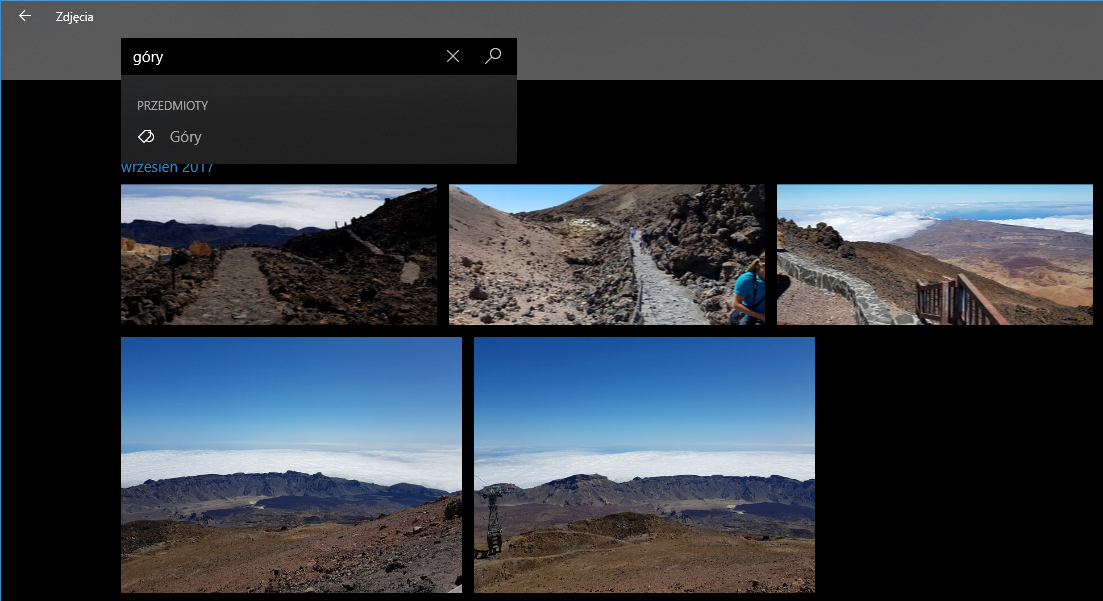

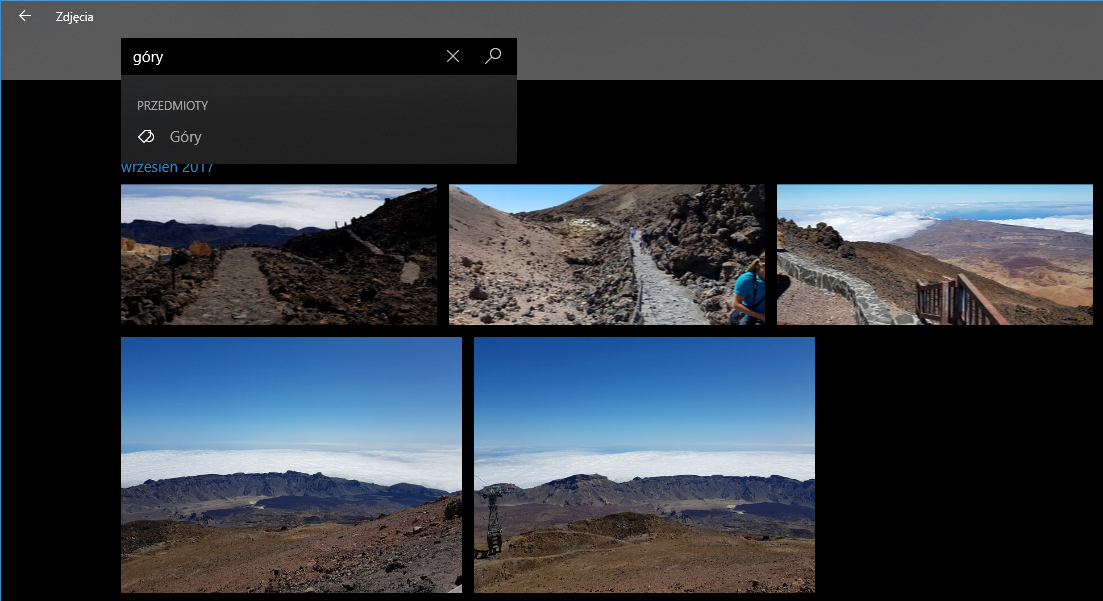

Dziś wystarczy, że włączę aplikację Zdjęcia w Windows 10 i w pole wyszukiwania wpiszę to, czego potrzebuję na daną chwilę. Jeżeli chciałbym powspominać wyprawy w góry, to śmiało wpisuję góry, naciskam Enter i program wyświetla mi kilkaset ujęć górskich. Skąd jednak aplikacja Zdjęcia wie, co znajduje się na fotografiach? Za tą wygodą wyszukiwania zdjęć, z której możemy wszyscy korzystać, kryje się Sztuczna Inteligencja…

Wszystko rozpoczęło się od trybu Smile Shot

Prekursorem detekcji obiektów na fotografiach było rozpoznawanie twarzy. Już w latach ’60 opracowano pierwsze – ręczne – metody rozpoznawania twarzy. Ogromny postęp w tej kwestii został poczyniony w latach ’90, kiedy to opracowano pierwsze skuteczne algorytmy rozpoznające twarze na zdjęciach. Przełomem na rynku konsumenckim był debiut aparatu Cyber-Shot DSC T200 w 2007 roku (dodam, że nadal można znaleźć go na rynku wtórnym za około 100 zł), który nie tylko potrafił rozpoznać twarze, ale nawet określić, czy osoby się uśmiechają. Mowa oczywiście o dobrze znanej dziś funkcji występującej w telefonach i aparatach – Smile Shot. Podczas wykonywania zdjęcia algorytm analizuje w czasie rzeczywistym, czy osoby znajdujące się w kadrze uśmiechają się. Jeśli tak, spust migawki jest wyzwalany automatycznie i w taki oto sposób mamy wykonane ujęcie z uśmiechniętymi osobami.

Spytacie: ale jak to działa? Bardzo prosto. Algorytm wbudowany w aparat szuka na zdjęciu trzech obiektów na podstawie wzorca: kącików oczu, kącików ust i zębów. Im oczy są bardziej zwężone, im kącik ust jest bardziej zadarty, a zęby są widoczne, tym większa pewność dla algorytmu, że osoba się uśmiecha.

Analiza zawartości fotografii

Nie sposób wytłumaczyć, jak działa Sztuczna Inteligencja w kontekście rozpoznawania zawartości zdjęć, dlatego posłużymy się mocnym uproszczeniem.

Co więcej, jeżeli będziemy rozumieć, jak działają te mechanizmy, to łatwiej będzie nam z nich korzystać. Trzeba oczywiście już w tym miejscu zaznaczyć, że to tylko komputerowe algorytmy, a jak każde oprogramowanie komputerowe, nie są one wolne od wad. Po kolei.

Jak człowiek rozumie świat, który go otacza?

Wyobraźmy sobie, że znajdujemy się w górskim kurorcie na jednym z głównych deptaków. Spoglądamy w stronę horyzontu. Co dostrzegamy? Dziesiątki osób w ruchu, budynki, witryny sklepowe, stragany z pamiątkami, architekturę miejską (latarnie, ławki), korony wysokich drzew za budynkami, stocza górskie w oddali, niebo z pojedynczymi chmurami. Od pierwszego planu, od szczegółowych i najmniejszych obiektów po najdalszy plan, z największymi obiektami, tudzież góry, niebo i chmury.

Rozpoznanie tych elementów wydaje się dla człowieka banalne, bowiem od dziecka mamy styczność z tak powtarzalnymi budynkami, krajobrazem i tak dalej. Utrudnijmy sobie odbiór tego samego miejsca. Jest noc, lekki opad deszczu i mgła. Co tym razem widzimy? Dodam tylko, że ludzki wzrok jest bardzo upośledzony po zmroku.

Widzimy tylko najbliższe otoczenie: pojedyncze osoby, zarys budynków i witryn sklepowych, ale bez szczegółów, a w tle z kolei ciemna otchłań, bez drzew, bez zarysu stoczy górskich, bez chmur. De facto to nadal to samo miejsce, ale już zupełnie inne obiekty są dostrzegalne. Tę samą sytuację można także sprowadzić do człowieka, a dokładniej do jego twarzy.

Czy gdy widzimy tę samą osobę, raz w okularach, czapce i zapłakaną, a w drugiej sytuacji, wesołą, bez okularów i czapki, to czy wiemy, że to ta sama osoba?

No właśnie. Ludzki mózg w pierwszej i drugiej sytuacji jest w stanie skojarzyć, czy dane miejsce, czy dana osoba jest tożsama. Nie mamy z tym większego problemu, bowiem posiadamy ogromną liczbę wzorców obiektów, zachowań, danych meteorologicznych, wspomnień i wiele więcej.

Jak powyższe sytuacje potrafiłaby zidentyfikować Sztuczna Inteligencja? Zależy to przede wszystkim od bazy wzorców i poziomu szczegółowości, z jakiej SI korzysta.

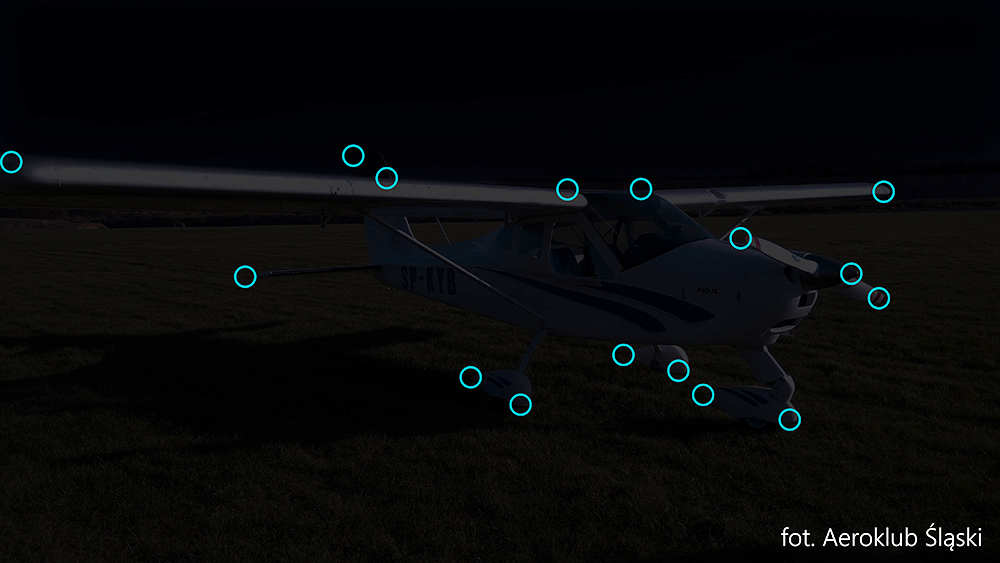

I tu docieramy do sedna. Mechanizmy analizujące zawartość zdjęć opierają swoje wyniki na ogromnej bazie wzorców obiektów, emocji ludzkich i rysów twarzy. Gdy mechanizm otrzyma zdjęcie do analizy, rozpoczyna dzielenie ujęcia na mniejsze fragmenty, z kolei na te fragmenty nakładane są markery (znaczniki) w najbardziej wyróżniających się miejscach. W kolejnym etapie wszystkie figury powstałe w oparciu o znaczniki są porównywane z bazą zawierającą miliony wzorców. Gdy znaczniki z naszego zdjęcia pokrywają się ze wzorcem, mechanizm zwraca nam informacje o rozpoznanym obiekcie i/lub współczynniku jego podobieństwa do wzorca.

Obrazując powyższą sytuację, weźmy za przykład poniższe zdjęcie. Przedstawia ono samolot, trawę, niebo. Mechanizm nakłada znaczniki na końcówki skrzydeł, statecznik pionowy, koła i tak dalej. Podobny wzorzec zostaje odnaleziony w bazie i mamy informację, że rozpoznany został samolot. Co jednak, gdy na naszym zdjęciu samolot będzie pod innym kątem? Zdjęcie będzie wykonane w nocy i statecznik pionowy nie będzie widoczny? Czy SI poradzi sobie z taką sytuacją? Tak, ale już z mniejszym prawdopodobieństwem, gdyż algorytmy analizują, czy figura powstała w oparciu o markery, jest odwrócona względem osi Y, X i Z, zatem w pionie, poziomie i przestrzeni (głębi). Mechanizm dokonuje korekty znaczników (tworząc figurę wzorcową) i dopiero taką figurę porównuje z bazą wzorców. Jest więc nadal duża szansa, że obiekt zostanie w pełni poprawnie rozpoznany. Gorzej już sytuacja wygląda, gdy na przykład w nocnej scenerii pionowy statecznik nie jest widoczny, co oznacza, że figura nie będzie w pełni identyczna z tą z bazy. SI także i w takiej sytuacji powinna sobie poradzić. Zwróci nam informację, że obiekt to samolot, ale określi także współczynnik poprawności rozpoznania, który będzie zdecydowanie niższy niż w przypadku w pełni poprawnego wzorca.

Ta właśnie ostatnia metoda – związana z ratingiem (oceną) prawdopodobieństwa, pozwala na rozpoznawanie uczuć ludzkich na podstawie zdjęć twarzy. Sztuczna Inteligencja nie będzie nigdy w stanie określić, czy na 100% poniższa osoba się cieszy czy jest smutna. SI wskaże nam po prostu wszystkie możliwe emocje wraz ze współczynnikiem. Im wyższy współczynnik, tym rozpoznana emocja jest bardziej prawdopodobna.

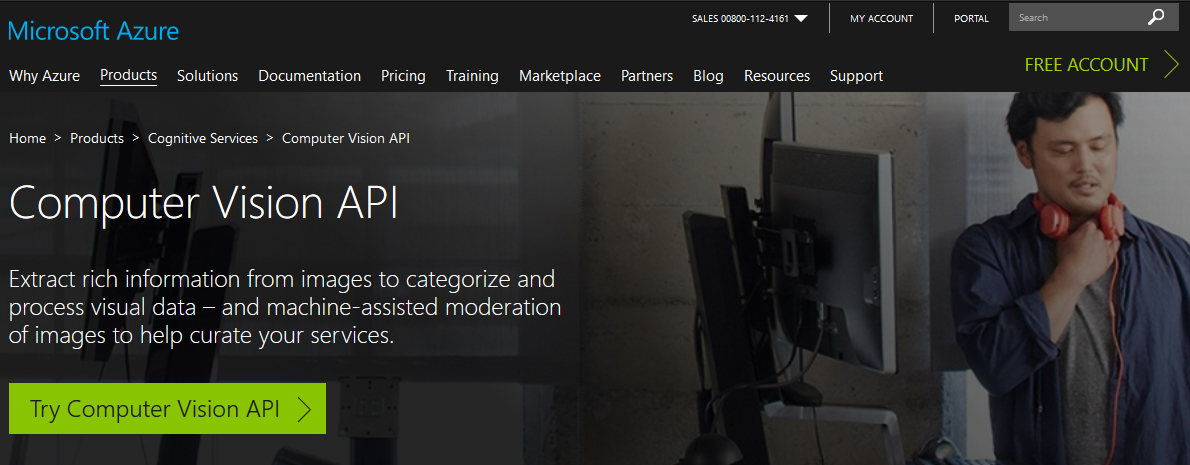

Sztuczna Inteligencja w Windows 10 napędzana jest przez Azure

Nie bez powodu opisywałem powyższe mechanizmy. Właśnie w oparciu o nie analizowane są wszystkie nasze zdjęcia, jakie gromadzimy na komputerze z systemem Windows 10 Fall Creators Update. Dokładniej rzecz ujmując, chodzi o aplikację Zdjęcia wbudowaną w system. Microsoft zaimplementował w niej trzy w pełni automatycznie działające mechanizmy:

- Computer Vision API – analizuje całe zdjęcie w celu identyfikacji jego zawartości. Mechanizm ten tworzy ogólny opis fotografii. To właśnie w oparciu o niego jesteśmy w stanie na przykład znaleźć wszystkie zdjęcia samolotów.

- Emotion API – analizuje zdjęcia podczas poszukiwania twarzy. Jeżeli je znajdzie, analizuje emocje osób. Mechanizm ten zwraca wyniki w postaci współrzędnych określających położenie twarzy oraz ocenę (rating) prawdopodobnych emocji. To właśnie za jego pomocą jesteśmy w stanie na przykład odnaleźć zdjęcia uwieczniające szczęśliwe chwile.

- Face API – analizuje zdjęcia podczas poszukiwania twarzy. Jeżeli je znajdzie, analizuje wygląd, płeć i wiek. Korzysta także z Emotion API. To za pomocą tego mechanizmu jesteśmy w stanie na przykład odnaleźć wszystkie zdjęcia z tą samą osobą, poznać jej wiek, płeć, kolor włosów, emocje czy nawet określić, czy osoba na zdjęciu nosi okulary.

Powyższe mechanizmy są systemami działającymi w pełni po stronie centrów danych platformy Microsoft Azure. Oznacza to tyle, że do analizy naszej kolekcji zdjęć nie jest wykorzystywana moc obliczeniowa naszych komputerów. Aplikacja Zdjęcia w momencie zlokalizowania nowych fotografii rozpoczyna przesyłać je do serwerów Azure, po stronie których w błyskawicznym tempie (kilkudziesięciu milisekund) dochodzi do analizy takich zdjęć za pomocą trzech powyższych mechanizmów. Po tej chwili program Zdjęcia otrzymuje dane opisowe zawartości zdjęcia w postacie zwykłego tekstu. I już dzięki temu możemy odnaleźć nasze zdjęcie poprzez wyszukiwarkę wbudowaną w program.

Co więcej, aplikacja automatycznie grupuje nasze fotografie na podstawie osób i emocji, co pozwala nam w błyskawicznym tempie wyświetlić wszystkie fotografie przedstawiające na przykład naszą babcię czy też osoby uśmiechnięte.

Sztuczna Inteligencja w akcji!

Znamy już genezę rozpoznawania obiektów na zdjęciach. Wiemy, jak jest ona przeprowadzana oraz jakie mechanizmy za nią odpowiadają. Czas więc przeprowadzić skrupulatne testy, które sprawdzą, co o naszych zdjęciach wie nasz komputer.

Pozwoliłem sobie przeprowadzić testy w dwóch fazach. Zarówno od strony użytkownika końcowego (domowego), który wyszukuje konkretne ujęcia za pomocą aplikacji Zdjęcia, jak i od strony dewelopera, tworząc prostą aplikację i implementując w niej trzy powyższe API. Wyniki tych testów przedstawiam poniżej.

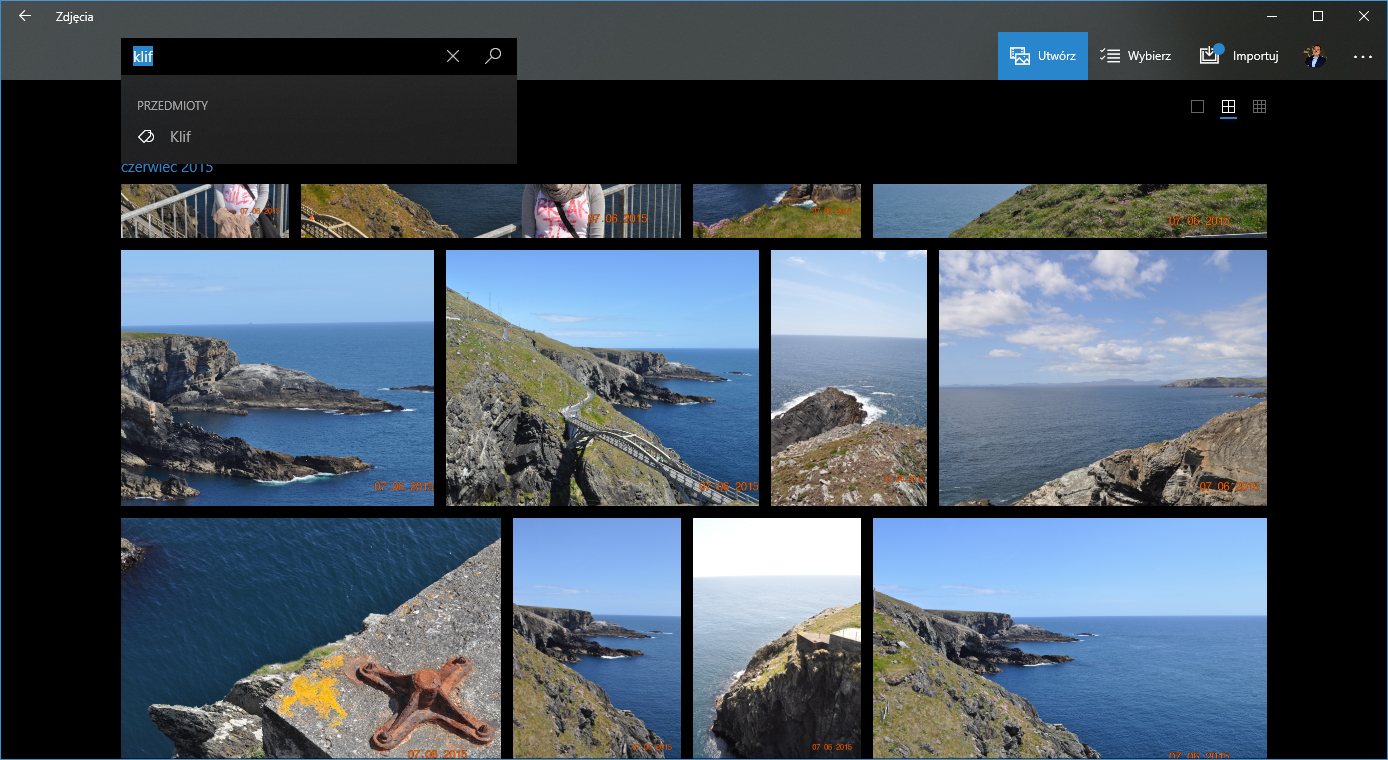

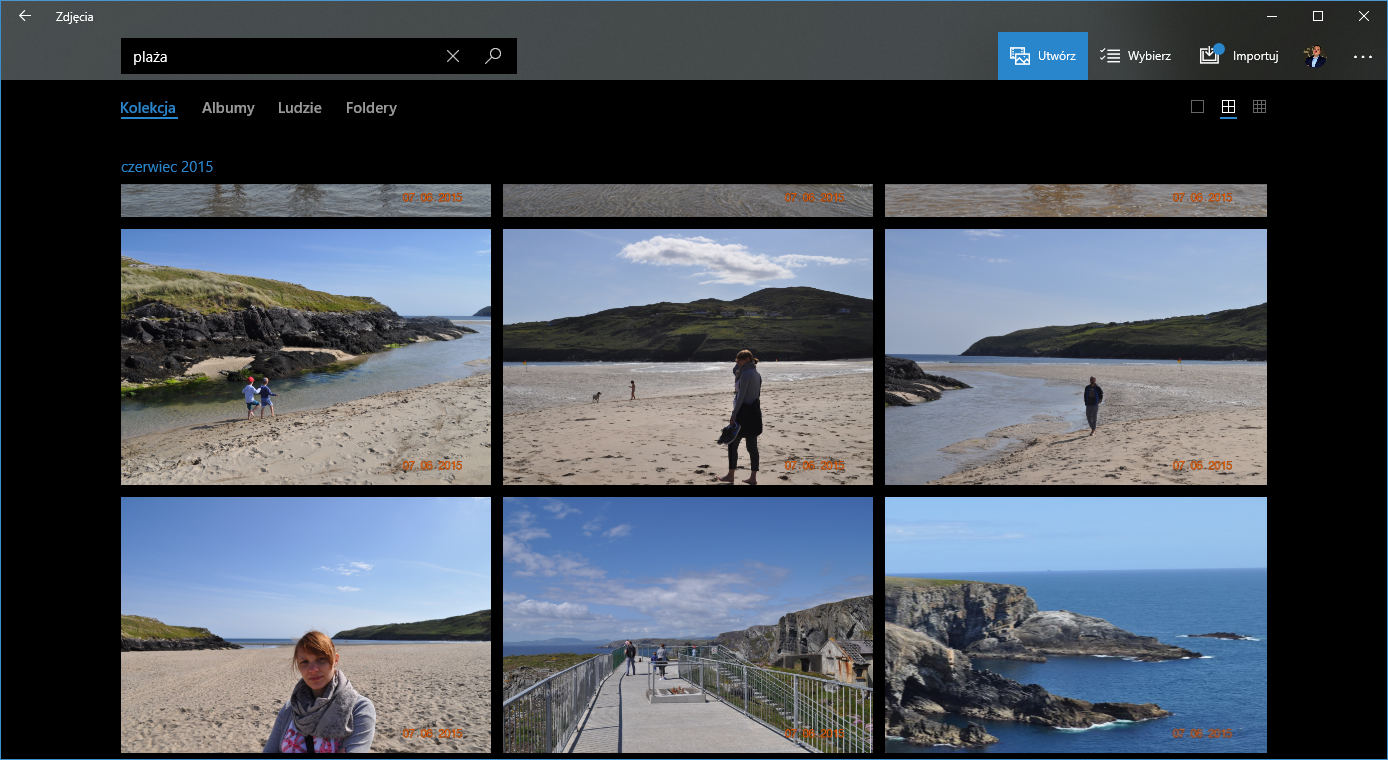

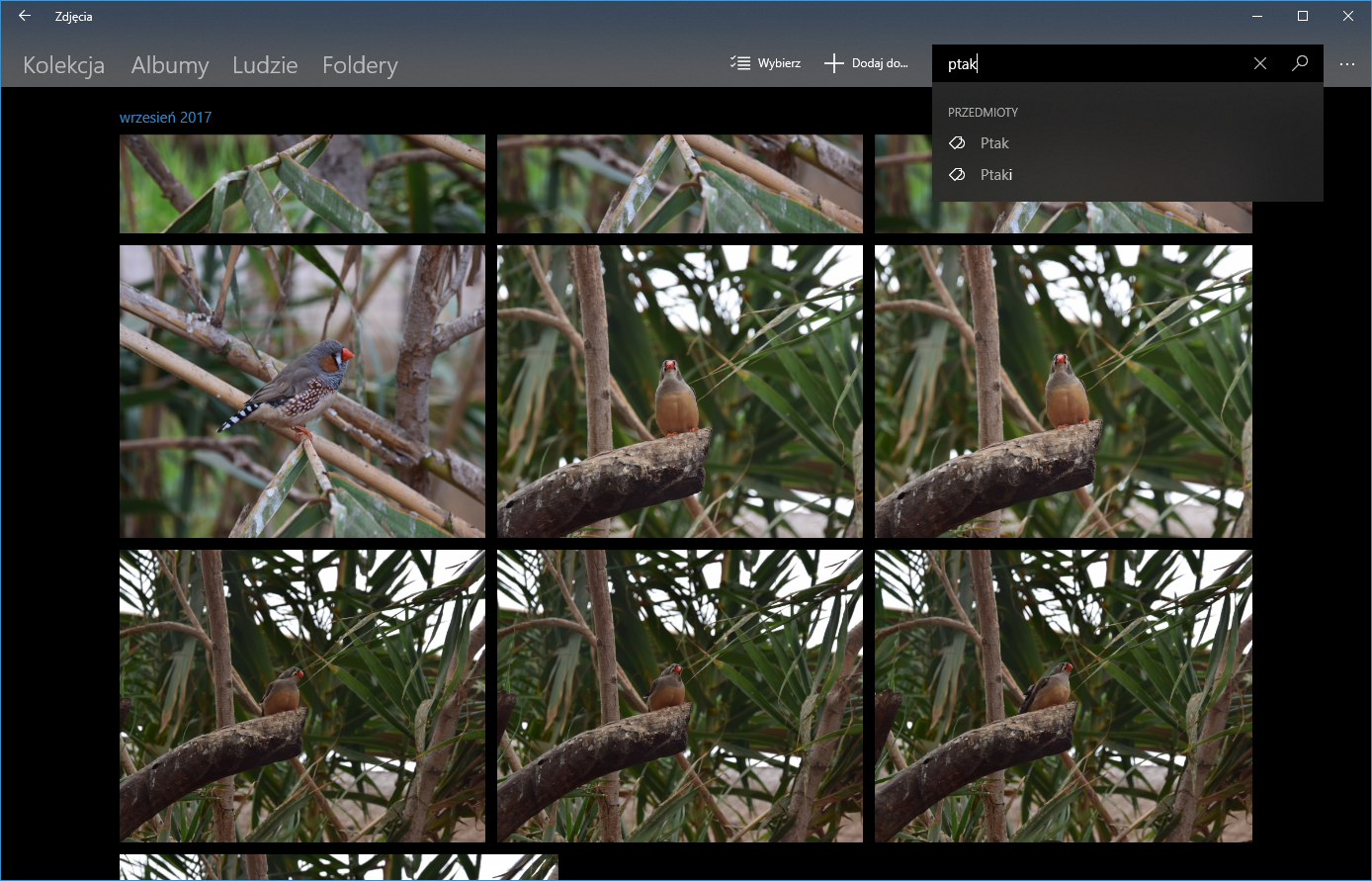

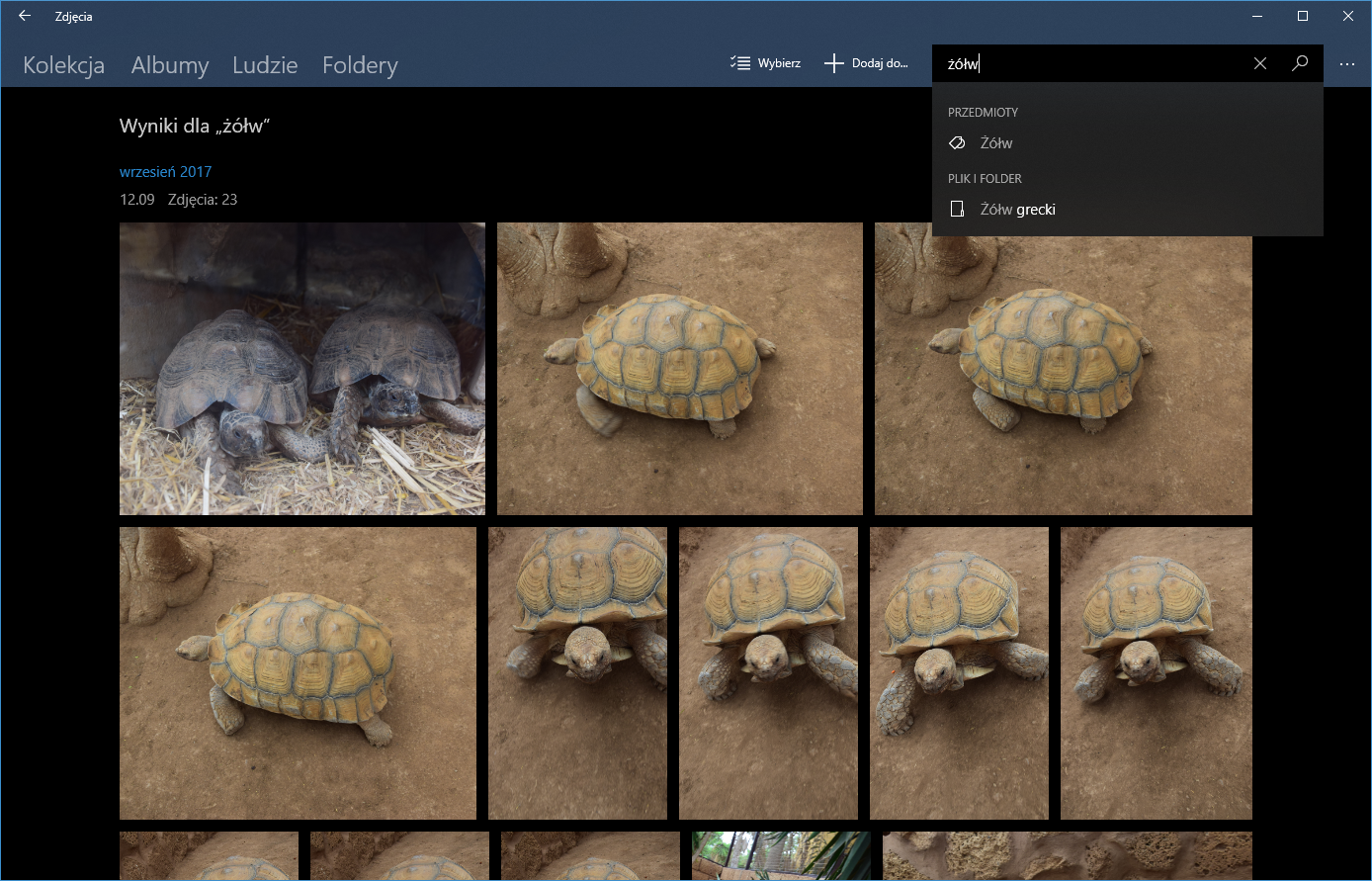

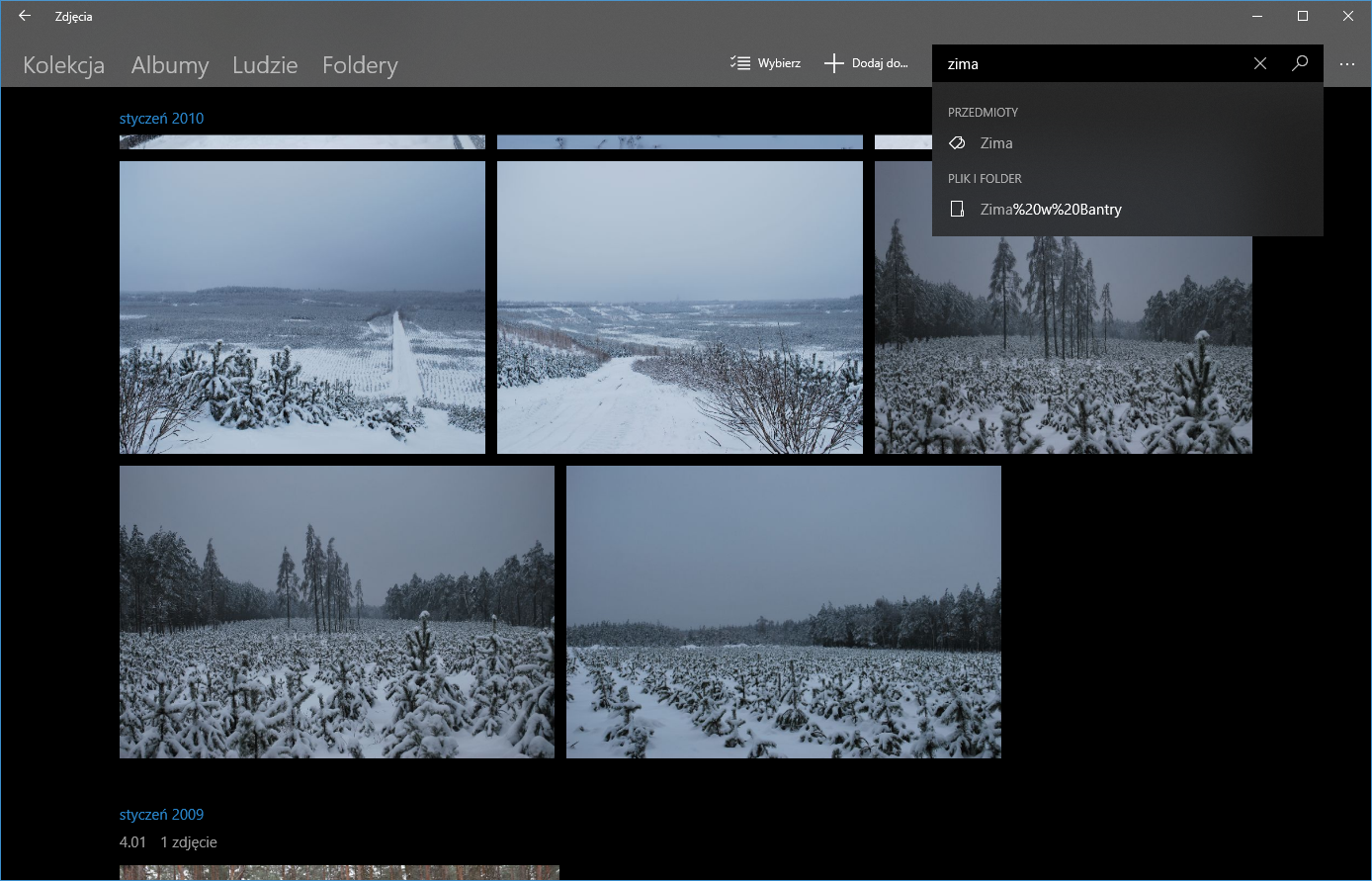

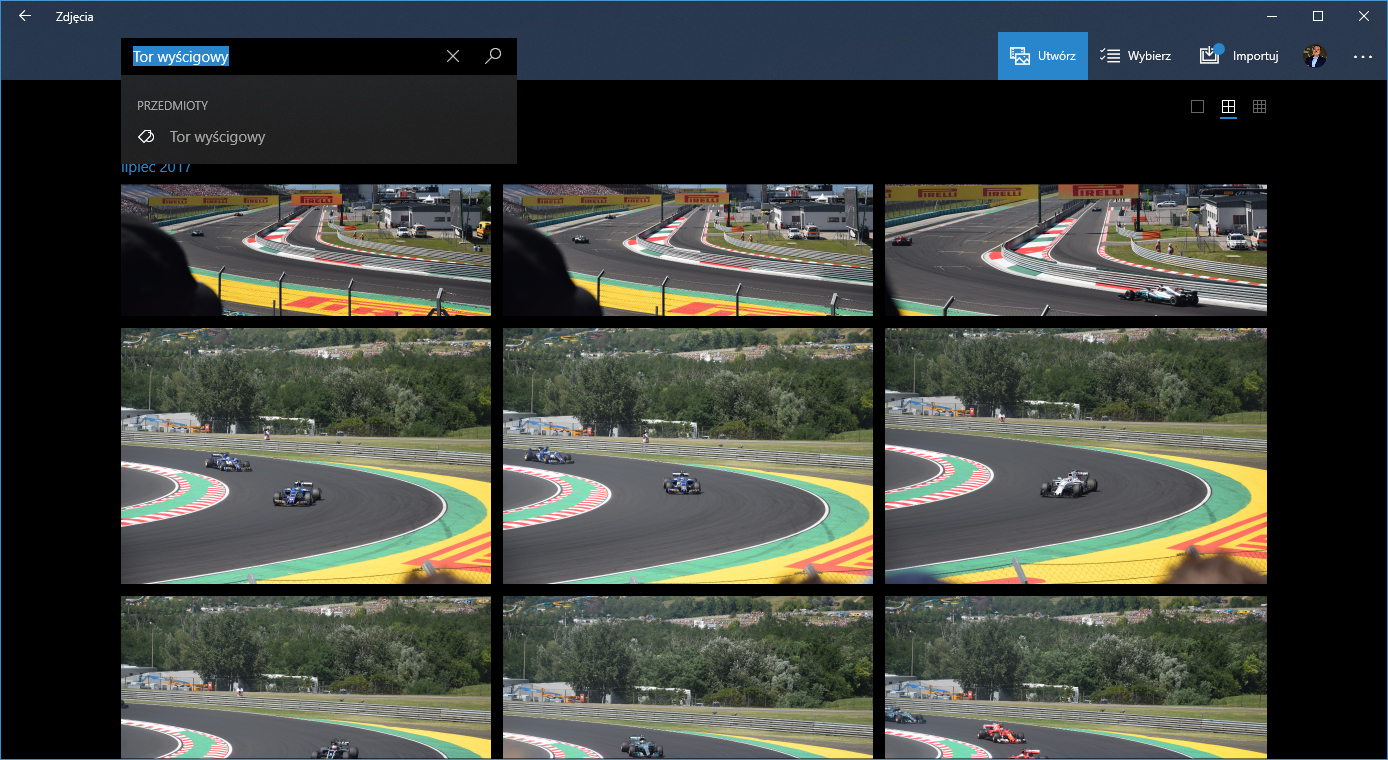

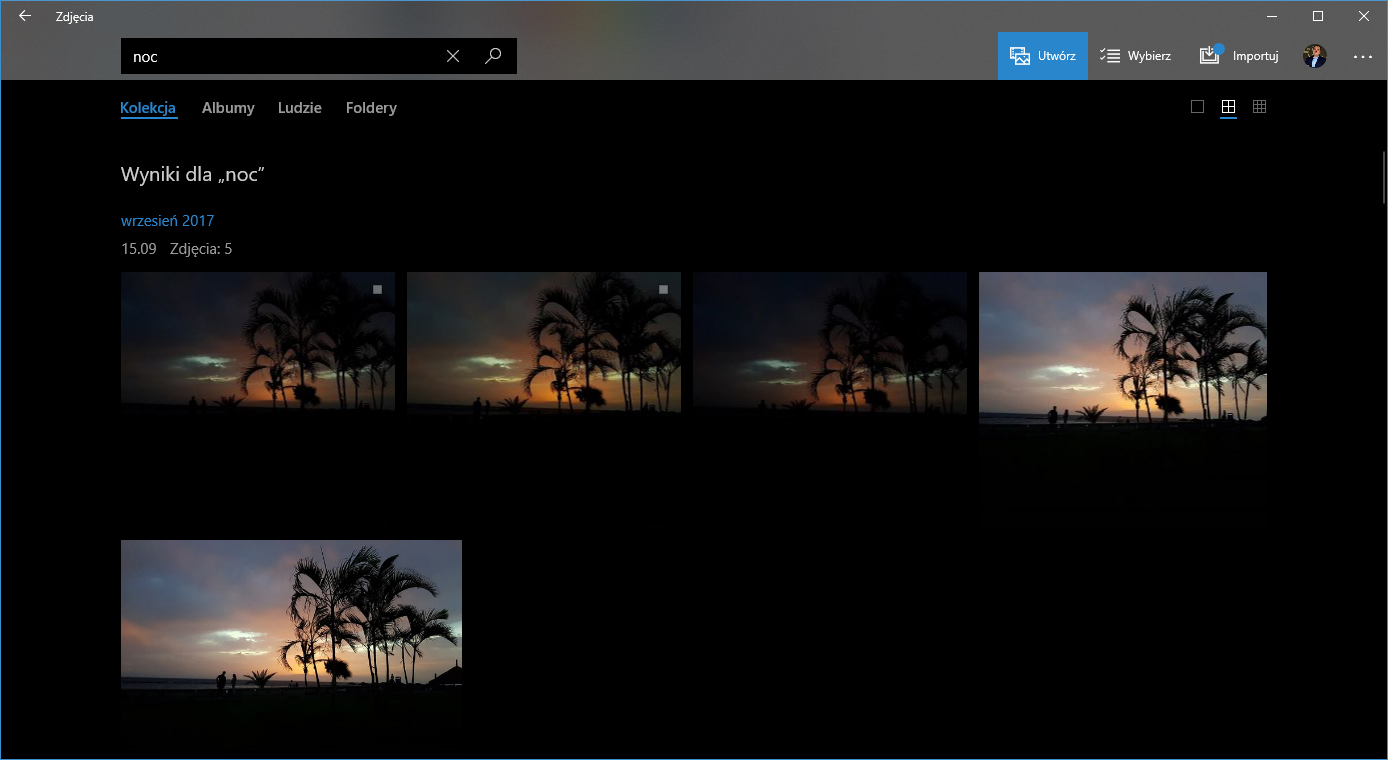

Podczas testów moim celem będzie odszukanie wspomnień z plażowania i wycieczek na klify. Ponadto chciałbym odszukać zdjęcia wykonane nocą, przedstawiające samochody i domy. Może weźmy sobie jeszcze na warsztat trzy dosyć szczegółowe i trudne sytuacje, mianowicie odnalezienie fotek uwieczniających posiłki (tudzież jedzenie), tor wyścigowy i kuchnię. Wyszukam także kilka dodatkowych sytuacji (zima) i zwierząt (ptak, żółw). Wyniki wyszukiwania przedstawiam poniżej listy. Podsumowując, w wyszukiwarkę w programie Zdjęcia wpisywać będę następujące zwroty:

- Góry

- Jedzenie

- Klif

- Plaża

- Ptak

- Żółw

- Samolot

- Kwiat

- Statek

- Zima

- Samochód

- Tor wyścigowy

- Dom

- Kuchnia

Rezultaty są bardzo zadowalające! Jednakże mam pewność, że aplikacja nie odnalazła wszystkich fotografii. Przykładowo, wyszukuję zdjęcia domów. Zwróconych było około 30 fotografii. Wystarczy szybkie zajrzenie w gąszcz moich katalogów i już wiem, że takich zdjęć mam ponad 100. Jeszcze gorzej wyszukiwarka poradziła sobie z nocnymi ujęciami. Otrzymałem raptem 15 zdjęć, a jestem świadom, że co najmniej 100 takich fotografii posiadam. Interesująco z kolei wygląda wyszukiwanie pomieszczeń, w moim przypadku kuchni. Faktycznie aplikacja Zdjęcia odnalazła kilkanaście takich fotografii z tylko jedną pomyłką – mianowicie z jednym zdjęciem toalety (sic!).

No właśnie, jak ze skutecznością? Wśród zdjęć domów mam także fotografię kozy; wśród jedzenia mam kaktusa na tle klifów; wśród ujęć z plaży mam jedno zdjęcie tarasu widokowego na tle klifów; wśród zdjęć z toru wyścigowego kilka przedstawia drogę ekspresową. W większości przypadków, kiedy wyszukiwałem konkretne zdjęcia, mechanizmy zwracały mi stosunkowo za mało fotografii, a ponadto wśród nich lądowały pojedyncze ujęcia niemające nic wspólnego z tym, czego szukałem.

Dlaczego? To postaram się sprawdzić w drugim teście, którego wyniki już za chwilę. Dodam jednak w tym miejscu, że mimo powyższych niedoskonałości, zwracane rezultaty były dla mnie satysfakcjonujące i o ile nie miałem wglądu we wszystkie możliwe dopasowania, o tyle mogłem cofnąć się w czasie i powspominać wypady sprzed lat…

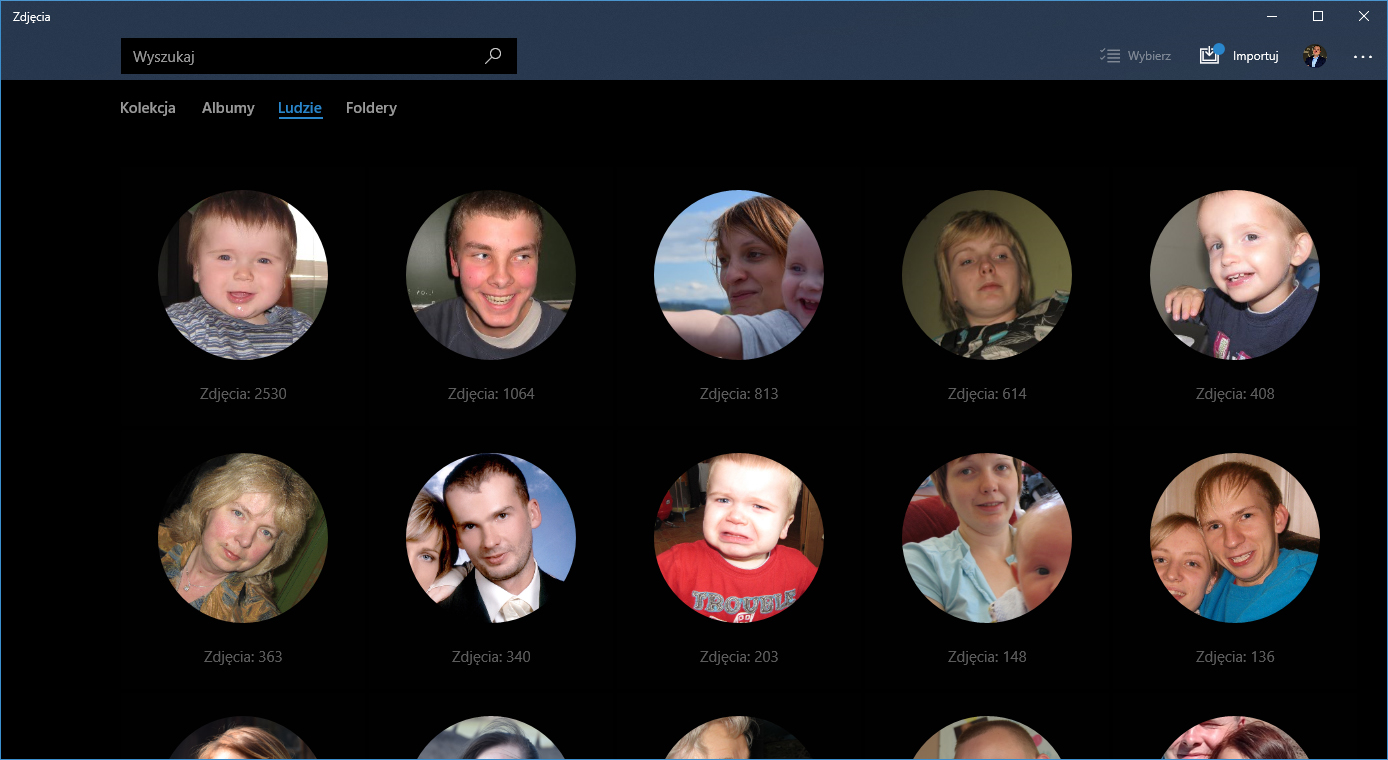

Ludzie, emocje, szczęśliwe chwile. To kolejna funkcja aplikacji Zdjęcia, grupująca nasze fotografie w oparciu o osoby i ich emocje. Tutaj największą siłą jest funkcja Ludzie. Jej kliknięcie powoduje wyświetlenie awatarów (automatycznie wygenerowanych) wszystkich unikatowych osób, jakie zostały rozpoznane. W moim przypadku takich osób było ponad 50. Pod każdym awatarem znajduje się z kolei liczba zdjęć z mojej kolekcji, na których to ta osoba została uwieczniona.

Gdy zobaczyłem te wartości, pomyślałem Wow! Naprawdę Face API bardzo dobrze radzi sobie z rozpoznawaniem osób i co ciekawe, na awatarze wyświetlane było moje zdjęcie sprzed 15 lat, a gdy wszedłem w wyniki, znajdowały się tam także moje współczesne fotografie. Świadczy to o tym, że mechanizm bardzo sprawnie rozpoznaje osoby nawet z uwzględnieniem dużych różnic wieku.

Jest jedno ale… Gdy przewijałem listę osób, w kilku miejscach znajdował się mój awatar z jeszcze innego okresu. I co gorsza, niejednokrotnie nie tylko mój. Świadczy to o tym, że mechanizm rozpoznawania osób jednak nie zawsze i nie do końca radzi sobie poprawnie z rozpoznawaniem tych samych osób. Wpływ na to ma wiele czynników: wspomniany wcześniej wiek osoby, kąt ustawienia twarzy, mimika (emocje), oświetlenie zdjęcia, fryzura i ubiór (okulary, czapka) czy nawet poziom naszego zmęczenia i stresu.

Na koniec postanowiłem skorzystać z jeszcze jednej funkcji wbudowanej w aplikację Zdjęcia. W górnej części okna programu znajduje się duży przycisk Szczęśliwe dni. Jego zadaniem jest wyświetlenie nam wszystkich zdjęć z osobami, które się uśmiechają. Niby prosta sprawa. Ok, klikam i co widzę? Setki zdjęć z osobami, uśmiechniętymi, neutralnymi, śmiejącymi się, z grymasem na twarzy na przykład spowodowanym dużym zimnem czy zmęczeniem. Czy to działa? Przeciętnie. O ile faktycznie większość zdjęć mógłbym zakwalifikować jako szczęśliwe dni, o tyle około 25% z nich nie ma nic wspólnego ze szczęściem. Co mechanizmy rozpoznały na takich zdjęciach? Sprawdzę za chwilę przy użyciu Face API.

Co o naszych zdjęciach wie Microsoft?

Dużo! Bardzo dużo! Codziennie użytkownicy systemu Windows 10 oraz dysku internetowego OneDrive gromadzą kolejne setki tysięcy zdjęć, które poddawane są analizie przez algorytmy heurystyczne (uczące się). Wyniki tych analiz zapisywane są między innymi w bazie wzorców w centrach danych Azure. Dzięki nim program Zdjęcia oraz wspomniane wcześniej mechanizmy dla programistów z każdym dniem coraz lepiej radzą sobie z rozpoznawaniem zawartości fotografii.

Postanowiłem więc przygotować prosty program w Visual Studio, aktywując powyższe API (może z nich skorzystać każda osoba przez 30 dni całkowicie bezpłatnie) i implementując je zgodnie z dokumentacją. Czas na testy. Poddam analizie zdjęcie z punktem widokowym (rozpoznanym w programie Zdjęcia jako plaża), zdjęcie kozy (rozpoznanej jako dom), zdjęcie toalety (kuchnia), drogi ekspresowej (tor wyścigowy) i jedno z moich zdjęć, na którym moja mina jasno nie wyraża szczęścia.

- punkt widokowy (rozpoznany jako plaża) – moja aplikacja zwróciła mi następujący opis zdjęcia: „Grupa ludzi chodzących po moście”. Co więcej, słów kluczowych (tagów) opisujących to zdjęcie jest aż 34. Im słowo wcześniej, tym otrzymało wyższy rating opisujący obiekty na zdjęciu. Pierwsza trójka prezentuję się następująco: płot, na wolnym powietrzu, most. Wszystko się zgadza! Gdzie więc ta plaża? Analizuję kolejne słowa: budynek, człowiek, balustrada, ławka, jazda konna (sic!), park, jazda na nartach (sic!), śnieg (sic!), tor, góra, owca, wzgórze, pies, pociąg, sztuczka. Nie ma plaży, ale za to są tak nietrafne określenia jak śnieg, pociąg czy też jazda konna. Dlaczego więc program Zdjęcia zakwalifikował mi to zdjęcie jako plaża?

- koza (rozpoznana jako dom) – aplikacja opisuje to zdjęcie następująco: „zdjęcia krowy patrzącej z bliska w obiektyw kamery”. Świetnie! Gdyby zamiast krowy była koza, opis byłby bezbłędny! Czytam dalej: zwierzę, ssak, krowa, aparat fotograficzny, blisko, na stojąco, głowa, ucho, oczy, owca, pies. Mechanizm działa naprawdę dobrze. Bardzo blisko 100% trafności w przypadku tego zdjęcia. Skąd więc dom? Z tego samego powodu, co pierwszej zdjęcie. To zdjęcie znajduje się w katalogu fotografii pochodzących ze skansenu, gdzie prawie wszystkie zdjęcia są ujęciami kilkuwiecznych chat.

- toaleta (rozpoznana jako kuchnia) – otrzymany opis: „łazienka z umywalką i oknem”. Bezbłędnie! Słowa kluczowe: wnętrze, łazienka, okno, lustro, pokój, biały, stół, wanna, prysznic. Większość określeń ze 100% trafnością. Moje zdjęcie oczywiście także znajduje się wśród ujęć kuchni, ale nie tylko. W tym przypadku uważam, że pomyłka programu Zdjęcia wynika z tego, że fotografia była indeksowana w czasach wersji testowych.

- droga ekspresowa (rozpoznana jako tor wyścigowy) – opis: "duży i długi pociąg na autostradzie". Słowa kluczowe: scena, droga, pociąg (sic!), tor, trawa, ulica, ruch drogowy, autostrada, most, miasto, park, autobus, jazda konna (sic!), stacja. Jest tor i to wyżej niż autostrada. Widać tutaj błąd popełniony przez Sztuczną Inteligencję. Jednakże opis zdjęcia odbiega jeszcze bardziej: pociąg na autostradzie. To nie scena z Incepcji, a tym bardziej na moim zdjęciu nikt nie jeździ konno.

- dwa zdjęcia przedstawiające moje emocje (oba rozpoznane jako Szczęśliwe dni):

- zdjęcie, na którym widać, że się uśmiecham: mechanizm dla szczęścia przydzielił ocenę 100%, a dla wszystkich innych emocji 0%. W pełni poprawnie. Co więcej, w wynikach widzimy, że osoba na zdjęciu to mężczyzna, bez okularów, w wieku 33 lata (o 3,5 roku za dużo), z minimalnym zarostem (10%) i o włosach koloru brązowego (100%), blond (64%), czarnego (45%), szarego (18%), czerwonego (5%) i innego (7%).

- zdjęcie, na którym widać, że mam neutralną minę: szczęście zostało ocenione na 24%, neutralność na 75%, inne emocje blisko 0%. Ponownie Sztuczna Inteligencja uznała, że jestem mężczyzną, w wieku 34 lata (o 4,5 roku za dużo), bez okularów, z zarostem na poziomie 10% i o włosach koloru brązowego (98%), blond (93%), szarego (43%), czarnego (15%), czerwonego (11%) i innego (9%).

Powody są dwa: po pierwsze zdjęcie to mam skatalogowane we wspólnym katalogu, w którym znajdują się głównie zdjęcia z plaży. Zatem program uznaje, że to zdjęcie także pochodzi z tej samej lokalizacji. Drugi powód: indeksowanie i analizowanie moich zdjęć było przeprowadzane jeszcze za czasów testowych wersji Windows 10 i aplikacji Zdjęcia. Być może mechanizm nie był jeszcze tak dobry, przypisał wyniki ze swojej pierwszej analizy i moje fotografie nie zostały już w późniejszym czasie poddane kolejnej analizie. Wróćmy do testów.

Według mojej oceny mechanizm bardzo sprawnie radzi sobie z osobami, ich wiekiem, płcią i oceną emocji. Mimo, że zdjęcie z neutralną miną traktowane jest jako Szczęśliwe dni, a moja mina jest neutralna, nie oznacza błędu. Rating dla szczęścia wynosi aż 24%, co de facto jest poprawne, bowiem delikatnie kąciki moich ust są uniesione. W tym teście SI firmy Microsoft zdecydowanie wygrywa!

Gdzie jeszcze Microsoft wykorzystuje Sztuczną Inteligencję?

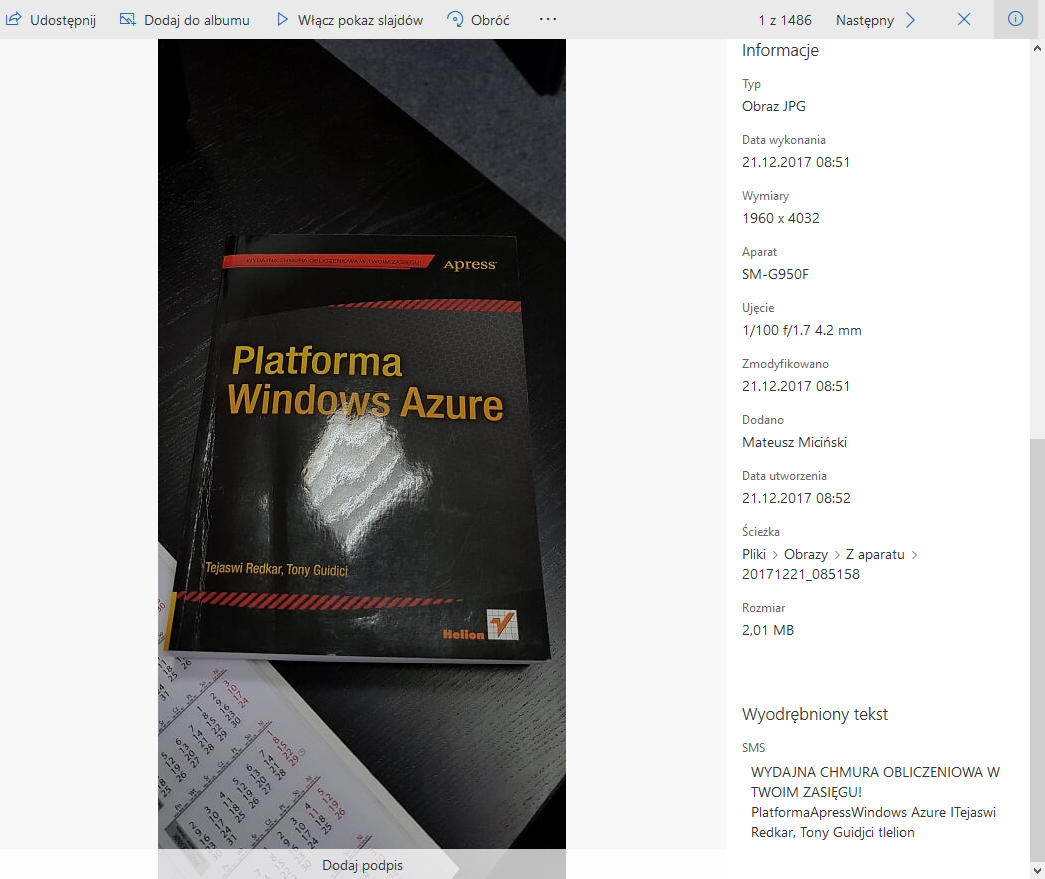

W dysku OneDrive. Nawet o tym wielu z Was zapewne nie wie! Zróbcie proszę telefonem zdjęcie na przykład okładce książki i wrzućcie to zdjęcie do chmury OneDrive. Zalogujcie się do dysku w przeglądarce i wyświetlcie wykonane przed chwilą zdjęcie. W górnym prawym rogu klikacie ikonkę i, a na dole po prawej wyświetlony zostanie tekst, jaki został rozpoznany na fotografii. W moim przypadku na 15 wyrazów tylko 3 zostały błędnie (z literówką) zinterpretowane. Także jeden wyraz jest w złej kolejności. Oczywiście ta funkcja nie jest jakąś zaawansowaną SI, a nawet mógłbym powiedzieć, że w ogóle nią nie jest, bowiem to klasyczny przykład mechanizmu OCR, które już były wykorzystywane naście lat temu i dołączane jako dodatkowe oprogramowanie do skanerów.

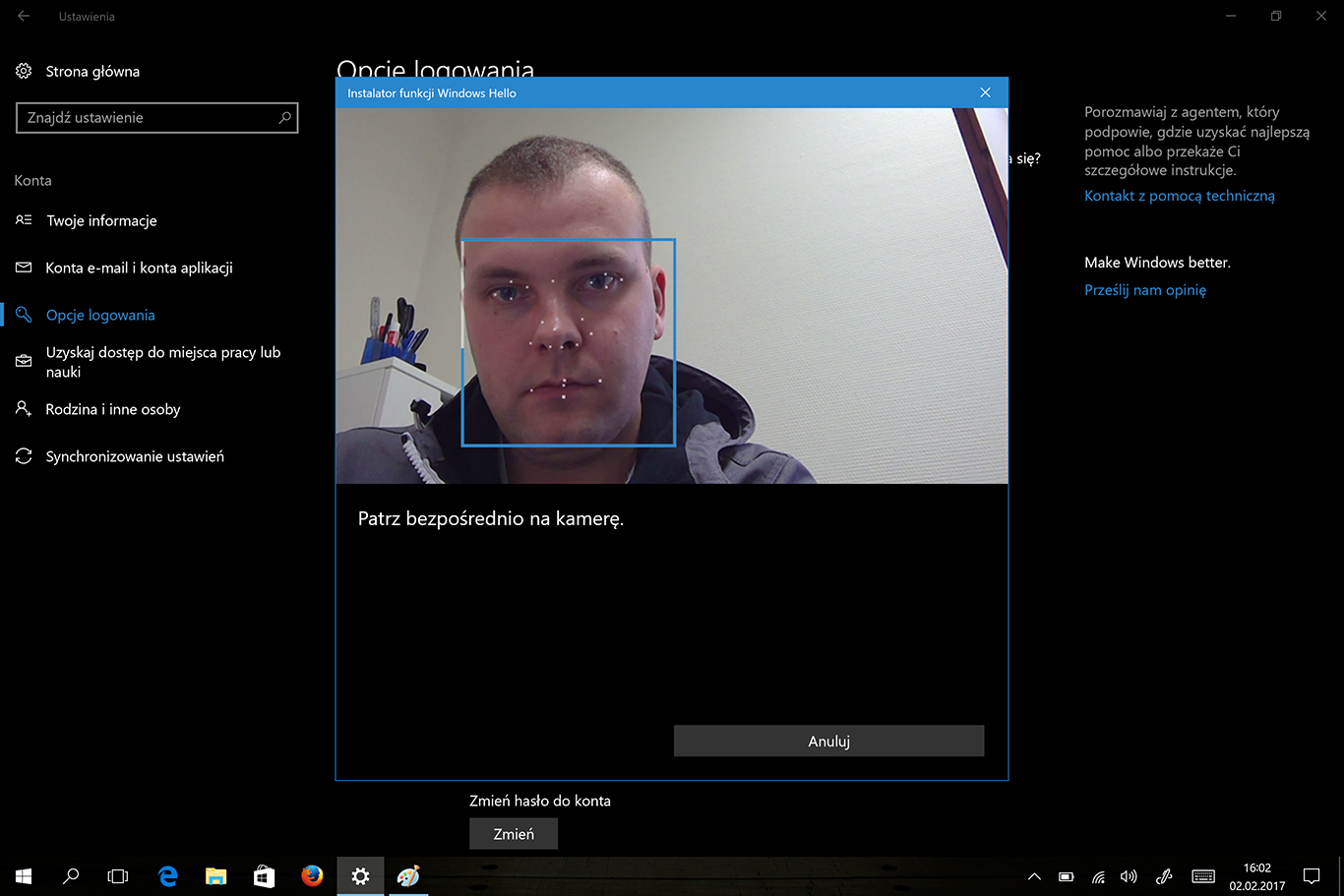

Innym przykładem wykorzystania mechanizmów rozpoznawania twarzy, emocji, mimiki jest zapewne wielu z Was znany Windows Hello. Zadebiutował on w telefonach Microsoft Lumia 950 i urządzeniach z linii Surface. I to w tym drugim przypadku Windows Hello działa wyśmienicie! Jest on oczywiście elementem autoryzacji biometrycznej, dzięki czemu do mojego Surface Pro loguję się nie hasłem, nie PIN-em, a moją twarzą. 5 minut wystarczy na porządne nauczenie mechanizmu rozpoznawania mojej twarzy. A potem: włączam Surface i w ułamek sekundy system mnie rozpoznaje i loguje do mojego konta.

Ok, gdzie jeszcze Microsoft wdrożył opisywane w tym artykule API? Wiemy o aplikacji Zdjęcia. Niewielu jednak wie o aplikacji Seeing AI. To zaawansowany program wspomagający osoby niewidome. Całą ideę wspomagania osób niewidomych w świecie, jaki ich otacza, zapoczątkował jeden z niewidomych pracowników giganta z Redmond - Saqib Shaikh. Nie będę się zbytnio rozpisywał, tym samym tym akcentem zakończę artykuł. Trzeba koniecznie obejrzeć poniższe wideo… (możecie zacząć od 1:05).