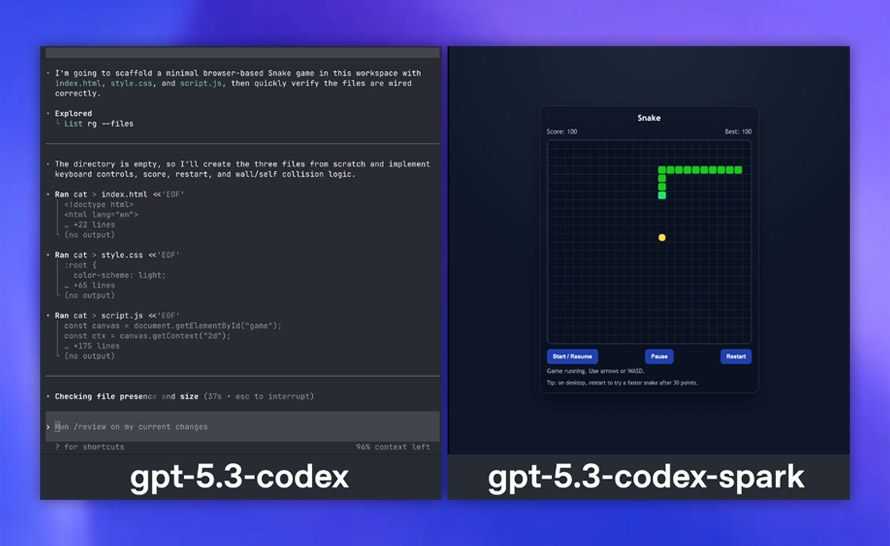

W tym tygodniu OpenAI wypuścił wersję zapoznawczą ultraszybkiego modelu kodującego modelu GPT‑5.3‑Codex‑Spark. To lżejsze wydanie znanego już GPT-5.3-Codex zostało zaprojektowane z myślą o maksymalnej responsywności. Oferuje aż 15-krotny wzrost szybkości generowania wyników, a dzięki optymalizacji pod kątem natychmiastowego działania pozwala na płynną iterację kodu, co drastycznie zmienia dynamikę pracy nad oprogramowaniem.

Pierwsza wersja Codex-Spark to efekt strategicznego partnerstwa OpenAI z Cerebras. Wykorzystanie zaawansowanego akceleratora Wafer Scale Engine 3 pozwoliło stworzyć model kodujący, który współpracuje z platformą Codex praktycznie w czasie rzeczywistym.

Dziś udostępniamy wersję poglądową GPT‑5.3‑Codex‑Spark, czyli mniejszego wydania GPT‑5.3‑Codex, który jest naszym pierwszym modelem stworzonym z myślą o programowaniu czasie rzeczywistym. Zoptymalizowaliśmy go tak, aby działał niemal natychmiastowo i zapewniał 15-krotnie szybsze generowanie wyników przy jednoczesnym zachowaniu wysokiej wydajności w rzeczywistych zadaniach programistycznych.

— OpenAI

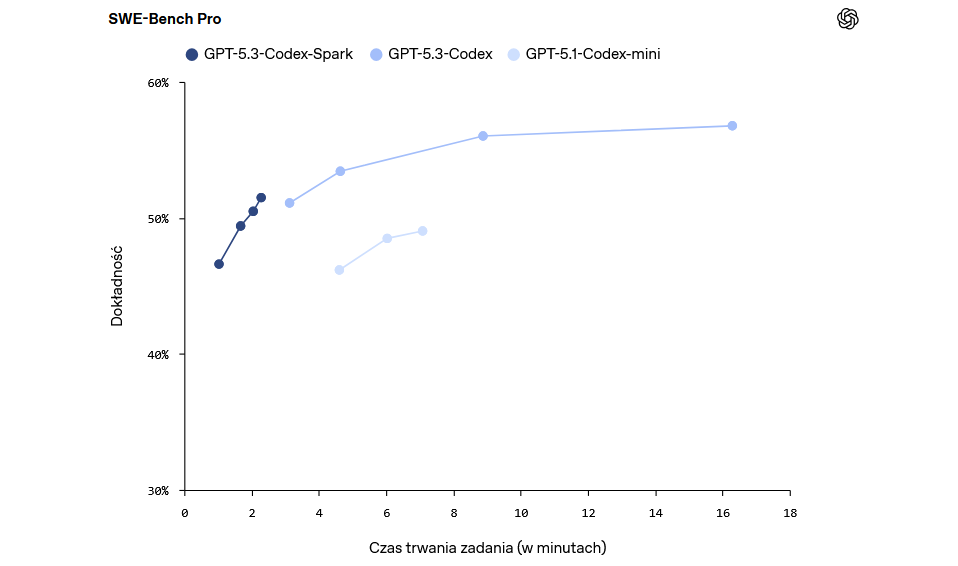

W przeciwieństwie do potężniejszych modeli, które specjalizują się w wielodniowych, autonomicznych zadaniach, Codex-Spark pełni rolę zwinnego współpracownika. Jego domeną jest interaktywna praca nad logiką, dopracowywanie interfejsów oraz wprowadzanie precyzyjnych korekt ad hoc. W benchmarkach zadań agentowych model ten ustępuje swojemu starszemu i większemu bratu, jednak nadrabia to nieproporcjonalnie większą szybkością działania. Cechuje go przy tym minimalistyczny styl pracy – domyślnie wprowadza on celowe poprawki i unika nadmiarowych działań, takich jak automatyczne uruchamianie testów, pozostawiając pełną kontrolę w rękach programisty.

GPT‑5.3‑Codex‑Spark jest już dostępny dla deweloperów w ramach subskrypcji ChatGPT Pro oraz wybranych partnerów API jako badawcza wersja poglądowa. Model operuje wyłącznie na danych tekstowych przy zachowaniu szerokiego okna kontekstu (128k). Jego wykorzystanie objęte jest osobnymi limitami, które nie obciążają standardowej puli użytkownika.

OpenAI wyjaśnia, że Codex-Spark przeszedł rygorystyczne testy bezpieczeństwa, w tym te dotyczące cyberzagrożeń. Zebrany na tym etapie feedback deweloperów posłuży do dalszej ewolucji modelu, w tym do wprowadzenia obsługi multimediów i jeszcze większych okien kontekstowych w przyszłości.