OpenAI ogłosił dostępność Codex Security, zaawansowanego agenta bezpieczeństwa aplikacji, który wyewoluował z projektu o nazwie Aardvark. Narzędzie, oparte na modelu GPT-5, ma za zadanie nie tylko wykrywać, ale i samodzielnie naprawiać krytyczne podatności w kodzie programistycznym.

Do niedawna projekt Aardvark był dostępny jedynie dla wąskiej grupy testerów w prywatnej becie. W piątek (6 marca 2026) OpenAI udostępnił go szerszemu gronu odbiorców pod nową nazwą w wersji Research Preview. Z narzędzia mogą już korzystać subskrybenci planów ChatGPT Pro, Team, Enterprise oraz Edu za pośrednictwem dedykowanego interfejsu Codex, a do końca marca korzystanie z usługi jest bezpłatne.

Codex Security rozwiązuje dwa kluczowe problemy współczesnej inżynierii oprogramowania. Po pierwsze, sztuczna inteligencja tak bardzo przyspieszyła pisanie kodu, że ręczne przeglądy bezpieczeństwa stały się niemożliwe do ogarnięcia. Po drugie, obecne na rynku narzędzia często generują "szum", flagując błędy o niskim znaczeniu lub zasypując programistów fałszywymi alarmami (ang. false positives), co marnuje czas zespołów IT.

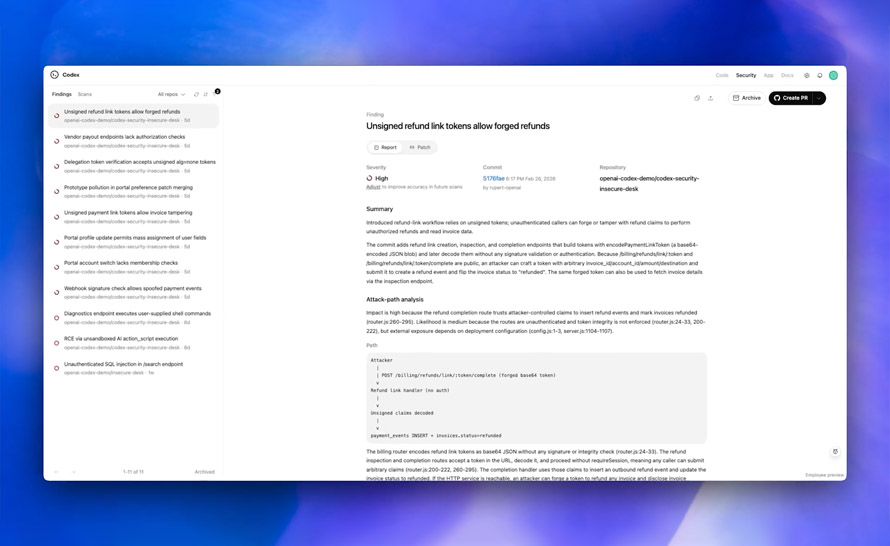

Nowe narzędzie stawia na rozumowanie agentowe i automatyczną walidację. Zamiast prostego skanowania buduje głęboki kontekst projektu, aby odróżnić teoretyczne błędy od realnych zagrożeń, które mogłyby zostać wykorzystane przez hakerów. Jak dokładnie działa Codex Security? Proces pracy agenta AI dzieli się na trzy kluczowe etapy:

- Analiza kontekstu i modelowanie zagrożeń: Po podłączeniu repozytorium AI analizuje strukturę systemu i tworzy edytowalny model zagrożeń. Określa on, co system robi, komu ufa i gdzie jest najbardziej narażony na atak.

- Priorytetyzacja i testy w piaskownicy: Wykorzystując model zagrożeń, agent szuka luk i testuje je w izolowanych środowiskach sandboksowych. Pozwala to na stworzenie dowodów słuszności (ang. Proof-of-Concept) dla znalezionych błędów, co daje pewność, że problem jest realny.

- Naprawa z uwzględnieniem logiki systemu: Na koniec Codex Security proponuje konkretne poprawki. Patche są projektowane tak, by pasowały do otaczającego kodu i minimalizowały ryzyko regresji, czyli przypadkowego zepsucia innych funkcji programu.

OpenAI informuje, że wczesne wdrożenia Codex Security pozwoliły wykryć m.in. błąd typu SSRF oraz krytyczną podatność uwierzytelniania między różnymi klientami. Dzięki nauce na podstawie feedbacku użytkowników w trakcie testów udało się też zredukować liczbę fałszywych alarmów o ponad 50%, zmniejszyć poziom "szumu" w raportach o 84% i ograniczyć zgłoszenia o zawyżonym priorytecie o ponad 90%.

W ciągu ostatnich 30 dni system przeskandował ponad 1,2 miliona commitów, identyfikując 792 krytyczne znaleziska. Co ważne, błędy o najwyższym priorytecie pojawiały się w mniej niż 0,1% skanowanego kodu, co potwierdza wysoką precyzję narzędzia i jego zdolność do wyłuskiwania tylko najważniejszych problemów z ogromnych mas danych.