Microsoft ogłosił wydanie swojego najnowszego modelu AI o nazwie Phi-4-reasoning-vision-15B. To już kolejny z tej rodziny. Jest to silnik z 15 miliardami parametrów, który ma stanowić przełom w dziedzinie multimodalnego rozumowania. Jako model multimodalny łączy on zdolność przetwarzania obrazu i tekstu, oferując wysoką wydajność przy zachowaniu relatywnie niewielkich wymagań sprzętowych.

Premiera modelu Phi-4-reasoning-vision-15B wpisuje się w rozwijany przez Microsoft trend tworzenia mniejszych, ale niezwykle inteligentnych modeli. Zamiast dążyć do nieograniczonego zwiększania liczby parametrów i tworzenia LLM-ów, zespół Microsoft Research skupił się raczej na optymalizacji architektury i rygorystycznej selekcji danych treningowych. Taka miniaturyzacja jest obecnie dość obiecującym podejściem, biorąc pod uwagę rozrastanie się dużych modeli na olbrzymią skalę, co według części ekspertów skończy się zderzeniem ze ścianą i pęknięciem bańki. Ale to już inny temat. Wróćmy do projektu Microsoftu.

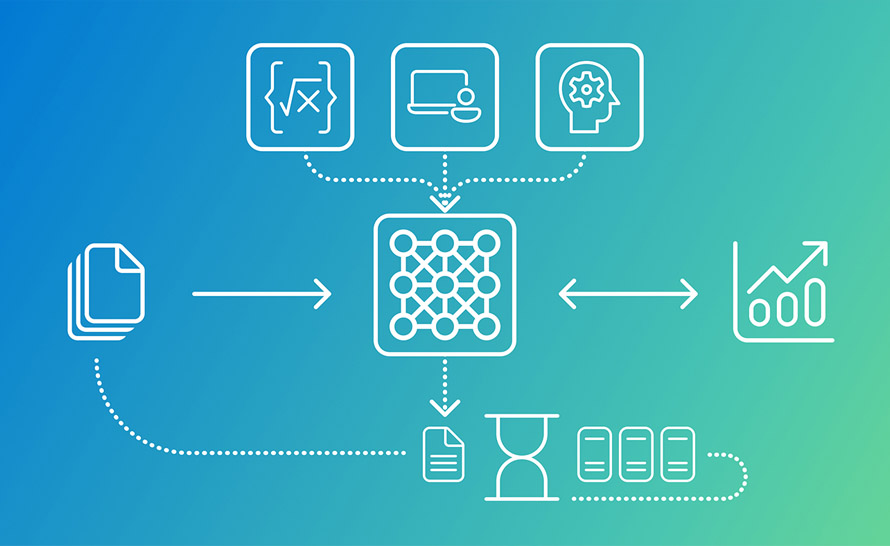

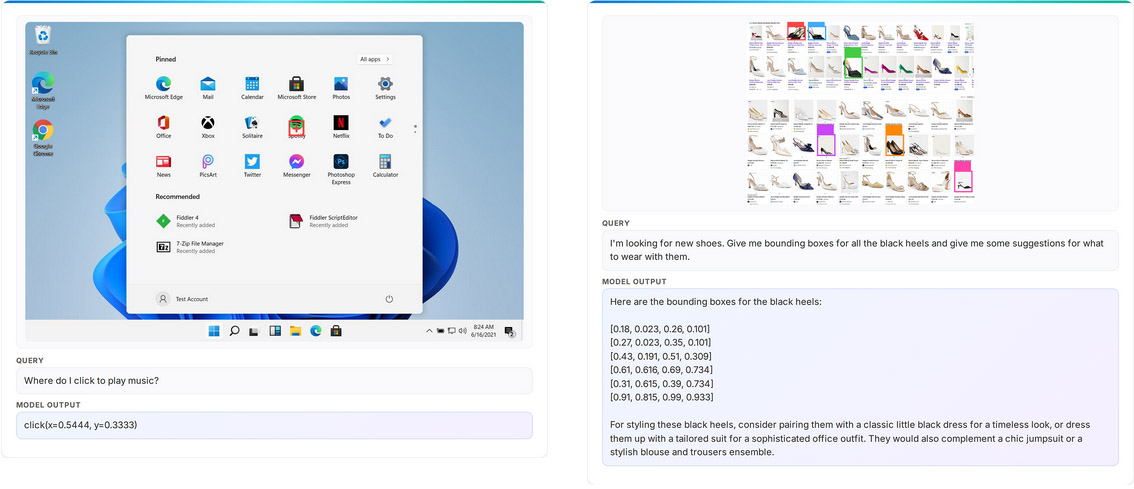

Nowy model oparty został na architekturze typu mid-fusion, która stanowi złoty środek między wydajnością a kosztami obliczeniowymi. Wykorzystuje ona wstępnie wytrenowany koder wizualny SigLIP-2 (w wariancie Naflex) oraz fundament językowy Phi-4-Reasoning. Wybór ten pozwolił na uzyskanie wyników porównywalnych z modelami, które wymagają 10-krotnie większej mocy obliczeniowej podczas trenowania i inferencji. Ważnym osiągnięciem jest także zastosowanie dynamicznej rozdzielczości. Podczas gdy wiele modeli ma trudności z odczytywaniem małych elementów na zrzutach ekranu lub skomplikowanych dokumentach, Phi-4 potrafi inteligentnie dostosować przetwarzanie obrazu, co znacząco poprawia precyzję w zadaniach typu OCR czy obsługa interfejsów użytkownika (UI).

Badacze z Microsoft zwrócili uwagę na efektywność procesu uczenia tego modelu. Phi-4-reasoning-vision-15B został wytrenowany przy użyciu zaledwie 200 miliardów tokenów danych multimodalnych. Dla porównania: konkurencyjne modele o podobnej wielkości, takie jak Qwen 2.5 VL czy Gemma 3, często wymagają ponad biliona tokenów.

W modelu tym wprowadzono innowacyjny podział na zadania wymagające myślenia/wnioskowania (reasoning) oraz te wymagające bezpośredniej percepcji. Model został wytrenowany w proporcji 20/80 (rozumowanie vs. percepcja). Użytkownicy mogą wymusić jedną z tych opcji, jednakże model ten podobnie jak GPT-5 potrafi on automatycznie przełączać się między dwoma trybami:

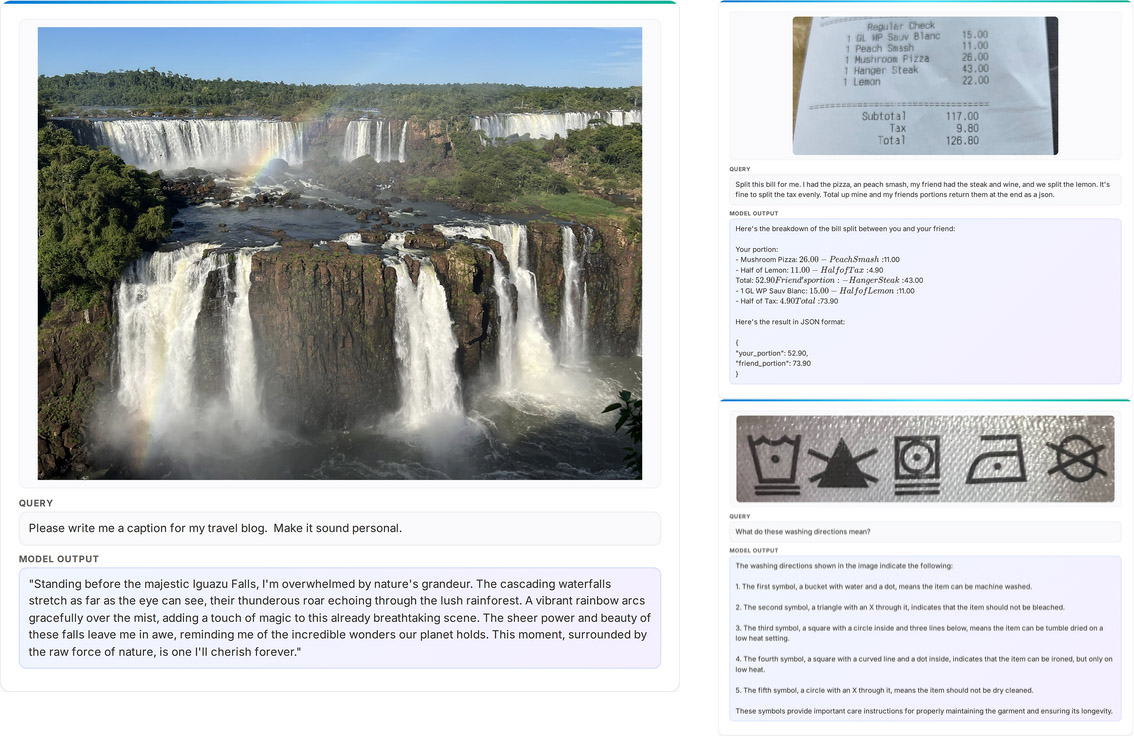

- Tryb bezpośredni (Non-reasoning): Wykorzystywany do prostych zadań, takich jak opisywanie zdjęć, rozpoznawanie obiektów czy odczytywanie paragonów. Pozwala to na minimalizację opóźnień (latencji) i oszczędność tokenów.

- Tryb dedukcyjny (Reasoning): Aktywowany przy złożonych problemach matematycznych i naukowych. Model generuje wtedy wewnętrzny „łańcuch myśli” (chain-of-thought), analizując krok po kroku dane wizualne przed podaniem ostatecznej odpowiedzi.

Dzięki doskonałemu zrozumieniu interfejsów graficznych (GUI) Phi-4-reasoning-vision-15B jest idealnym fundamentem dla tzw. Computer-Using Agents (CUA). Potrafi on lokalizować przyciski, menu i pola tekstowe na ekranach komputerów i urządzeń mobilnych, co otwiera drogę do automatyzacji skomplikowanych zadań agentowych w środowisku systemu, przeglądarki czy aplikacji. Model wykazuje też ponadprzeciętne zdolności w interpretacji wykresów, rozwiązywaniu zadań z fizyki czy chemii na podstawie rysunków oraz analizowaniu trendów w sekwencjach obrazów.

Zgodnie z zasadami Odpowiedzialnej AI model został poddany rygorystycznym testom pod kątem bezpieczeństwa, wykorzystując zarówno publiczne, jak i wewnętrzne zestawy danych do eliminacji szkodliwych zachowań. Phi-4-reasoning-vision-15B jest dostępny na platformach HuggingFace, GitHub oraz poprzez Microsoft Foundry.

Dowiedz się więcej z naszych artykułów: